很高興今天(2019/12/26)受INTEL及MAKERPRO邀約和大家分享「智能機器手臂之3D感測視覺系統」。此次主要分享內容是介紹如何整合RealSense和OpenVINO藉此來完成智能小蕃茄採收機器人系統。雖然這個系統非常陽春且不成熟,不過麻雀雖小但五臟俱全,從資料集建立、訓練、推論及物件深度分析一樣不少,還提供所有資料集及源碼供大家研究,希望有興趣的朋友未來想開發類似系統時能少踩一些坑。

本次簡報主要內容如下:(點擊圖片放大)

- 智能機器手臂之3D感測視覺系統

- 固定式RealSense + 機器手臂

- 移動式RealSense + 機器手臂

- RealSense + XYZ直交型機器手臂

- FBTUG 採果機器人專案

- 採收機器人─立體視覺技術

- 智能機器手臂視覺系統開發流程

- 立體視覺原理

- D415 & D435 規格比較

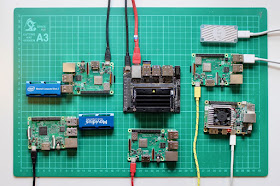

- 小蕃茄物件及深度偵測實驗平台

- YOLOv3小蕃茄偵測流程

- 小蕃茄取像

- 影像標註

- 小蕃茄物件偵測實驗結果

- 應用注意事項

- Github開源專案

- RealSense LiDARD(光達) L515

- 參考文獻