一年一度電腦圖學及人機互動領域最頂級的研討會「ACM SIGGRAPH 2018」這兩天(8/12~16)在加拿大溫哥華盛大舉行。此次不只聚集了全世界最頂尖的學術研究人員發表最新研究成果,更吸引眾多廠商展出相關技術,連NVIDIA執行長黃仁勳都親自前往推廣自家最新技術及產品。

由於個人對實境互動這個領域非常著迷,所以每年總會花點時間關注這個研討會相關技術的最新動態。除了相關論文外,個人尤其對「先進技術(EMERGING TECHNOLOGIES)」這個分項特別感興趣,因為這個項目綜合了最新技術及實機展示,同時提供參觀民眾感受最具未來感的體驗,比起那些充滿學術理論讓人暈暈欲睡的論文要有趣的多了。

今年「先進技術」項目共收錄了來自全世界24個團隊的展出項目,很可惜台灣今年無人上榜。雖然今年無緣前往實際體驗,但從先前官方釋出的影片就可看出相當精采,不過遺憾的是官方只收錄了8個項目的片段,其它部份可能就得自行參閱官方網站了。目前這些展出項目的正式論文尚未釋出,為了讓大家能更進一步了解影片中介紹的內容,以下僅就個人觀點做一點簡單摘要及說明,希望能讓大家能對這些技術更加了解,如有認知錯誤或有其它看法歡迎留言一起討論。

SIGGRAPH 2018 Emerging Technologies官方影片:

由於個人對實境互動這個領域非常著迷,所以每年總會花點時間關注這個研討會相關技術的最新動態。除了相關論文外,個人尤其對「先進技術(EMERGING TECHNOLOGIES)」這個分項特別感興趣,因為這個項目綜合了最新技術及實機展示,同時提供參觀民眾感受最具未來感的體驗,比起那些充滿學術理論讓人暈暈欲睡的論文要有趣的多了。

今年「先進技術」項目共收錄了來自全世界24個團隊的展出項目,很可惜台灣今年無人上榜。雖然今年無緣前往實際體驗,但從先前官方釋出的影片就可看出相當精采,不過遺憾的是官方只收錄了8個項目的片段,其它部份可能就得自行參閱官方網站了。目前這些展出項目的正式論文尚未釋出,為了讓大家能更進一步了解影片中介紹的內容,以下僅就個人觀點做一點簡單摘要及說明,希望能讓大家能對這些技術更加了解,如有認知錯誤或有其它看法歡迎留言一起討論。

SIGGRAPH 2018 Emerging Technologies官方影片:

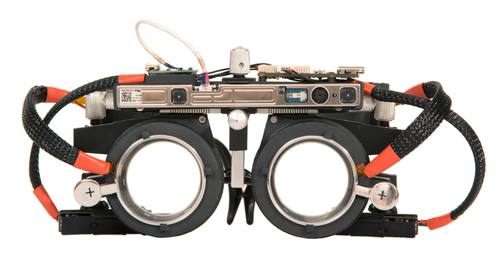

[1] AutoFocals: Gaze-Contingent Eyeglasses for Presbyopes (自動聚焦眼鏡:為老花眼而設計的眼動跟踪眼鏡)

大家都知道年紀大了就有老花眼,看遠看近總是要把眼鏡拿上拿下的,尤其像我們這種又有近視又有老花眼的更是麻煩。Stanford大學團隊提出的這項技術結合了場景3D掃描(深度感測器)、紅外線(攝像頭)追瞳及鏡片自動調焦技術。首先讓系統以紅外線攝像頭偵測眼睛(瞳孔)的位置,接著計算視點匯聚於場景的深度(物件的位置),最後再依對焦的深度自動調整光學焦距,如此一來看遠看看近就能自動調整焦距就不用換眼鏡了。

[2] FairLift: Interaction with Mid-Air Images on Water Surface (FairLift:與水面上的懸浮圖像進行交互)

一般來說真正的浮空投影受限於物理現象並無法真實存在,常見的作法都是將影像投影在看似透明材質的物體上,使觀賞者能同時看到影像及真實環境,誤以為影像浮在半空中。一般常會利用半反射鏡斜放(金字塔或倒金字塔型)、氣(霧)幕、水簾、全息膜甚至黑紗網等方式達成。Electro-Communications大學則直接利用投影機投影在水面產生浮空視覺效果。為了讓使用者能有互動,且看起來具有深度,則需於使用者上方加置深度感測器來偵測手的位置及深度,再依其資訊改變投影內容物的位置及尺寸,達到擬真互動效果。

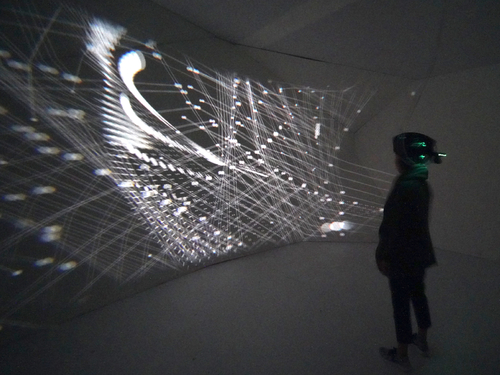

[3] HeadLight: Egocentric Visual Augmentation by Wearable Wide Projector (HeadLight:一款通過可穿戴式的廣角投影儀產生的以自我為中心的視覺增強裝置)

我們經常可看到俗稱「光雕」的立體投影技術,這是一項結合場景立體(深度)掃描結合變形貼合投影的技術,通常需要很多前置作業及內容調整才能正確投影在立體物件(比方說大樓或雕像)上,且多半只能呈現在靜物上。SonyCSL提出一項可穿戴式投影系統,結合3D掃描及微投影機製作成一頂類似安全帽的互動投影儀。它具有105度水平和55度垂直範圍內的視角投影角度。使用前先將場景及對應內容建置好,當使用者於場景中走動時,會即時計算使用者的位置(X,Y,Z)及視角(俯仰、傾斜及旋轉),再投景出正確變形的影像,使其完全貼合於立體場景及物件上,以增強使用者視覺效果。用更簡單的說法,這是一項「動態光雕」技術。

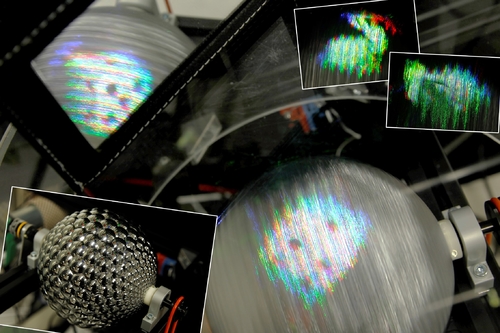

[4] Spherical Full-Parallax Light-Field Display Using Ball of Fly-Eye Mirror (使用球狀蠅眼反鏡的球面全視差光場顯示器)

傳統平面顯示器,不管視點移動到,顯示內容都一樣,和觀看真實物件時不同視角會看到不同影像有所不同。所謂「視差(Parallax)或光場(Light-Field)」都是指當眼睛移動一個微小距離(角度)後所看到影像的差別,包含水平(X)、垂直(Y)及前後(Z)方向。當觀賞者以一個物件當作中心繞著走時,觀賞者在每個視角所看到的景像應該都會不同。為了產生這樣的影像,通常必須是電腦圖學或多攝影機方式取得各個視角的影像,再快速播放還原,如此即可產生全視差的光場顯示器。此次Nagaoka科技大學提出了一項和先前技術不同的作法,主要利用一台高速投影機配合一個具有像蒼蠅複眼半球面反射鏡高速旋轉,來產生全視角影像。簡單來說就是當球體旋轉一個微小角度就投影一個視角影像,而每張影像又被微半球面鏡陣列反射到各個角度,當球體高速旋轉時,利用人眼1/10秒影像暫留效應,就達到使觀賞者看到完整立體影像效果,且允計不同觀賞者於不同視角同時觀賞不同視角影像。

註:更多光場顯示器技術可參閱個人先前發佈文章「超黑科技_光場攝影及顯示技術發展趨勢_Part 3_光場顯示器的原理 」

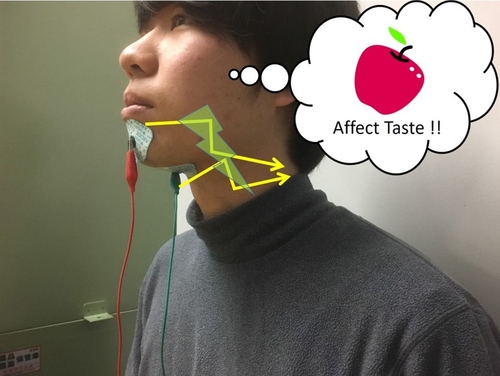

[5] Taste Controller: Galvanic Chin Stimulation Enhances, Inhibits, and Creates Tastes (味覺控制器:可加強、抑制和創造味覺的電流下頜刺激器)

看過電影「一級玩家」、「獵殺代理人」的人都希望未來在虛擬世界中除了視覺、聽覺、觸覺能虛擬化外,更希望嗅覺、味覺也能虛擬化,如此才有真正完整身臨其境的感覺。以往在虛擬味覺部份較少人提出研究成果,此次Tokyo大學提出以電流刺激下頜(GJS)技術,利用不同電流刺激,不須通過額外的化學材料或侵入式設計即可改變使用者的味覺。

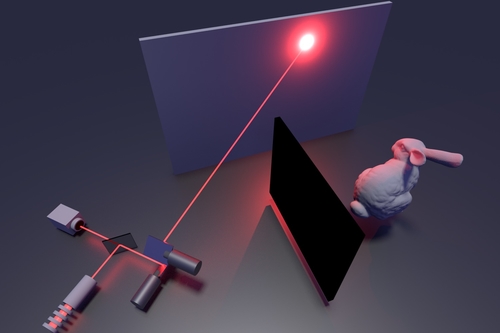

[6] Real-Time Non-Line-of-Sight Imaging (實時非視線成像技術)

當一個物體隱藏在屏風之後一般攝影機就無用武之地了,若將屏風換成金屬板時,那即便是X光也難以穿透,進而觀察到遮蔽物後的物體。Stanford大學此次提出利用一組雷射配合兩個(XY方向)轉向鏡在遮蔽物旁的牆面來回掃描,此時遮蔽物後方物件也會被雷射照到,同時物件也會將極微弱的雷射順著原光路反射回雷射光源處,在此只需利用分光鏡同時接收反射回來的微弱光源,經計算後即可快速重建遮蔽物背後物件隱約形狀,對於了解遮蔽物後方物體內容有很大幫助。

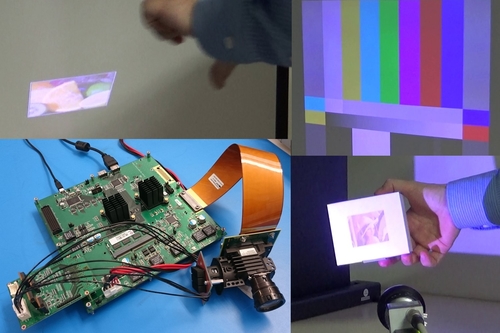

[7] A Full-Color Single-Chip-DLP Projector with an Embedded 2400-fps Homography Warping Engine (配有2400幀率同形變形引擎的全彩色單芯片DLP投影機)

一般LCoS投影機是將光源投射LCD上再反射或穿透鏡頭成像,因此速度很難提昇,頂多120Hz。而傳統DLP投影機是用一個白色光源利用色輪分色,將不同顏色光源投射在微反射鏡陣列來產生彩色影像,雖然顯示速度已有明顯提升,但對於要在移動物件上精準投影則明顯不夠快。Tohoku大學此次提出用高速LED光源來取代色輪分色,配合原先DLP能快速反應特色,做出一台全彩(RGB24bit)並可超過2400fps的投影機,僅透過標準的HDMI和USB接口即可做到,且無須太多的運算即可達成。

[8] Fusion: Full Body Surrogacy for Collaborative Communication (Fusion:可協作溝通的全身支架)

以前在學習某些體育項目時,雖然老師認真演示,但我們在學習時總抓不到要領,直到老師貼身拉著我們的手才能正確操作。本次Keio及Tokyo大學團隊共同提出一項類似外骨骼機器人的系統,除了機械雙臂及靈活的手指外,另外還搭載雙攝像頭立體視覺,可進行場景(物件)位置(深度)計算。這項系統可允許兩個參與者遠端共享操作,主要包含直接協作、強制身體引導和誘發身體運動等。如此以後即備教練沒空親臨現場也可遠指導了。

另外還有16項技術未收錄至影片中,有興趣的朋友可自行到 SIGGRAPH 2018官方網站作更進一步了解。

本文歡迎轉發(貼)及非商業用途使用,若有引用部份文章或圖片時煩請註明「資料來源:歐尼克斯實境互動工作室 作者:Jack Hsu」及本文網址,謝謝!

沒有留言:

張貼留言